L’intelligence artificielle (IA) alimente de nombreux mythes. Entre autres, celui d’être à l’avenir douée de capacités cognitives identiques à celles de notre cerveau. L’IA est pourtant loin de pouvoir mimer le fonctionnement cérébral. Explications de Matteo Di Volo, chercheur en neurosciences à l’Institut des cellules souches et du cerveau (SBRI) de Lyon.

Depuis l’irruption brutale de ChatGPT en novembre 2022, l’intelligence artificielle (IA) est sortie des labos. Bouleversant les outils technologiques de notre quotidien, elle est passée sur le devant de la scène publique et médiatique. Il est question de prendre le train en marche sous peine de se faire dépasser. Le public peu averti craint les bouleversements à venir, tandis que les effets d’annonce s’enchaînent, alimentant toutes sortes de mythes. L’un d’entre eux correspond à l’avènement d’une « super intelligence artificielle » dotée de capacités cognitives similaires à celles des êtres humains. Une IA capable entre autres d’analyser par elle-même un problème, de le comprendre et de trouver une solution.

Cette super IA est-elle réaliste ? Pour bientôt ? Selon Jensen Wang, le dirigeant du fabricant de puces informatiques Nvidia, qui s’exprimait sur ce sujet en novembre 2023 lors d’un événement du New York Times, une IA capable de réussir des tests aussi compliqués que ceux maîtrisés par les humains serait envisageable d’ici cinq ans. Demis Hassabis, cocréateur de DeepMind, la société de Google spécialisée en IA, tient quant à lui des propos prudents. Docteur en sciences cognitives de l’University College de Londres, l’entrepreneur britannique a estimé dans les colonnes du Point, en mars dernier, que l’avènement d’une IA générale « n’était pas hors de portée, mais qu’elle viendrait progressivement » et par étapes. Pas d’échéance donc.

Empiler des réseaux de neurones artificiels permet d’augmenter la puissance de calcul des machines.

Argument marketing ou pas, imiter les capacités exceptionnelles du cerveau humain est une ambition clairement affichée par les promoteurs de l’IA. L’équivalent d’une quête du Graal… « C’est déjà notre cerveau qui, à travers son architecture et son fonctionnement, a inspiré les travaux précurseurs de l’IA des années 50 », observe Matteo Di Volo, chercheur au SBRI de Lyon en neurosciences computationnelles, une discipline qui vise à développer des modèles mathématiques pour simuler le fonctionnement cérébral à l’aide de l’informatique.

C’est en effet en cherchant à modéliser la perception visuelle humaine par une série d’opérations mathématiques très simples que des scientifiques ont créé les premiers réseaux de neurones artificiels (RNA). A la base de ces algorithmes de calcul sophistiqués, des fonctions mathématiques dont les valeurs s’ajustent automatiquement grâce à un processus d’apprentissage (voir figure 1). Et selon Matteo Di Volo, les règles d’apprentissage édictées à l’époque, calquant grossièrement celles qui régissent le passage des impulsions électriques dans nos propres neurones, n’ont guère évoluées.

Dans le cadre de ses travaux de recherches, le neuroscientifique lyonnais s’intéresse à l’information réellement contenue dans l’influx nerveux lors des oscillations cérébrales, et à la façon dont elle est encodée. Avec un objectif : reproduire cet encodage au plus près, autrement dit concevoir des modèles de réseaux de neurones artificiels mimant la biologie réelle du cerveau. « Les algorithmes de calcul sur lesquels repose l’IA aujourd’hui utilisent un grand nombre de RNA, organisés sous forme de couches. La forme d’apprentissage de ces RNA dits « profonds » constitue le deep learning », explique le chercheur. Empiler un nombre considérable de RNA profonds est la solution actuellement mise en œuvre pour augmenter la puissance de calcul des machines de deep learning et les rendre plus efficaces. Mais leur taille s’en trouve augmentée pareillement, ainsi que leur consommation énergétique.

« Une alternative serait de revoir l’organisation des réseaux de neurones et leurs règles d’apprentissage en calquant davantage la réalité des processus biologiques, commente Matteo Di Volo. Sans reproduire le cerveau, cette IA biologique serait plus puissante et plus fonctionnelle. En outre, son développement permettrait de mieux comprendre le fonctionnement du cerveau, si mystérieux encore à bien des égards ». Outre le gain de place qu’elle permettrait s’agissant des machines, cette IA pourrait encore faire preuve de flexibilité en adaptant ses réponses à son environnement de travail, ce dont sont incapables les modèles actuels conçus pour réaliser une seule tâche de façon optimale. Mais pour que cette vision d’une IA biologique se concrétise, il s’agirait de résoudre, au moins, deux défis de taille en termes de modélisation.

Les populations de neurones interconnectées synchronisent l’émission de leurs signaux électriques.

Le premier concerne un phénomène cérébral fondamental pour des fonctions cognitives comme le contrôle de nos mouvements et la perception sensorielle, et que l’IA actuel n’intègre pas : la gestion de l’information dans le temps. Notre cerveau est en effet capable d’orchestrer à tout moment les impulsions électriques produites isolément par chacun de ses neurones. Et il en contient 80 milliards ! Il est capable de synchronisation cérébrale. Nécessaire au vivant, la synchronie est un phénomène que l’on trouve aisément dans la nature. Elle caractérise des événements qui surviennent en même temps.

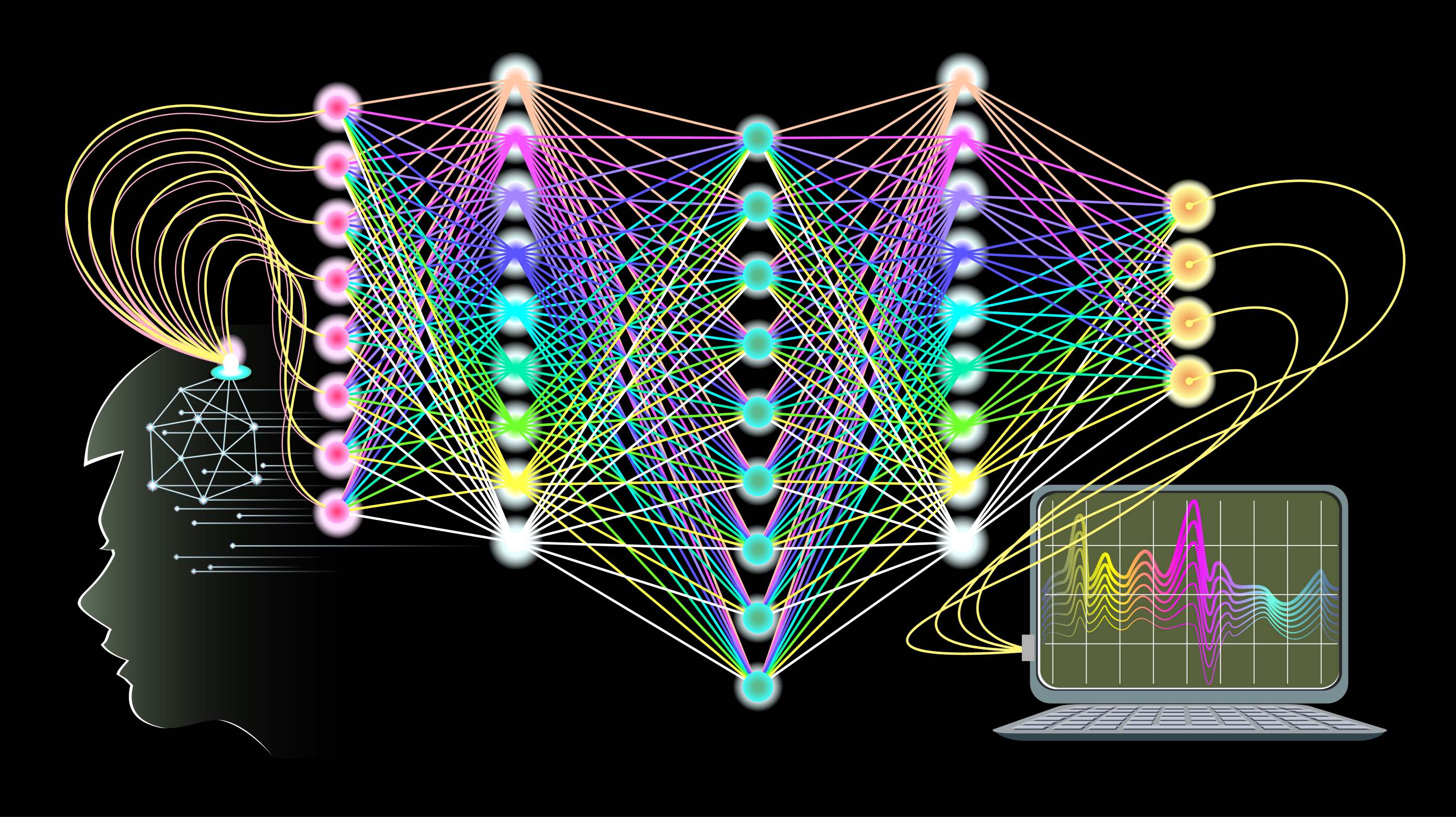

A l’instar des lucioles qui clignotent en même temps pour communiquer, les neurones synchronisent l’émission de leurs signaux électriques © DR (lucioles) | J.Prada and coll – Plos Computational Biology (neurones connectés)

C’est le cas par exemple des lucioles qui ajustent le rythme de leur clignotement sur celui de leurs voisines pour attirer des partenaires et se reproduire, ou le cas des bancs de poissons qui changent de direction simultanément à l’approche d’un prédateur (voir figure 2). Dans le cerveau, cette synchronisation s’observe à l’échelle des populations de neurones interconnectées qui émettent des signaux électriques au même instant, renforçant ainsi leurs connexions. L’orchestration temporelle a lieu aussi à l’échelle macroscopique : des régions cérébrales synchronisent leur activité pour les besoins d’une tâche particulière, les flux d’informations s’en trouvant coordonnés.

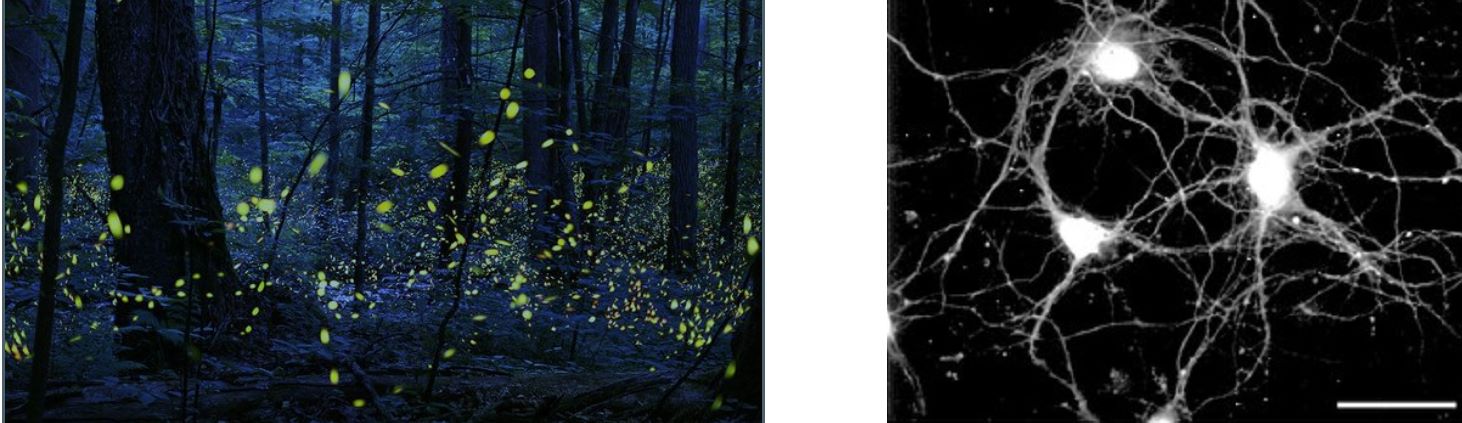

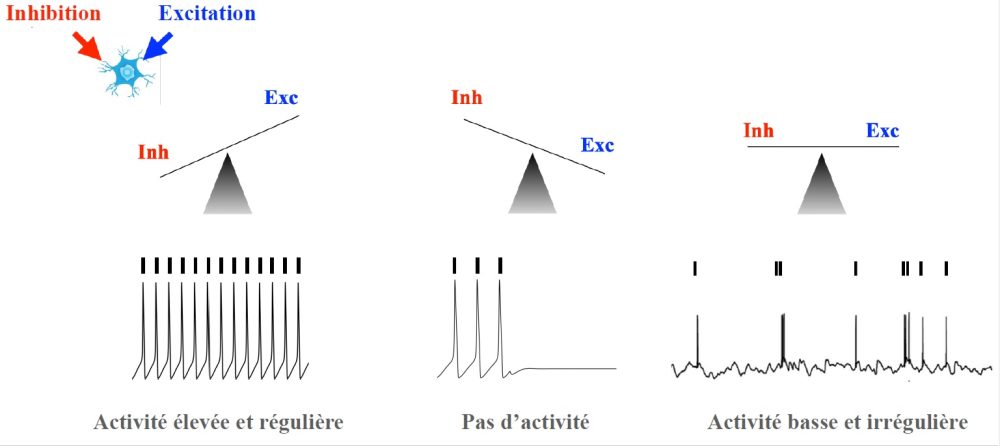

Le deuxième défi a trait à une observation déconcertante : l’activité des neurones cérébraux apparaît irrégulière et chaotique. En étudiant le fonctionnement du cerveau, on ne peut qu’être fasciné par son extrême précision. Il en faut peu pour imaginer que cet organe, à l’instar d’une IA, se comporte de façon déterministe. Qu’une seule et même action génère une activité neuronale unique et reproductible. « Il n’en est rien, objecte Matteo Di Volo. Lorsqu’une même tâche est exécutée plusieurs fois et qu’on enregistre le niveau d’activation des neurones (leur potentiel électrique, ndlr) impliqués dans celle-ci, on observe qu’il est à chaque fois très différent. Pourtant le résultat, c’est-à-dire l’action, est identique. Cette activité qui apparaît irrégulière induit une complexité qu’on a du mal à expliquer » (voir figure 3).

Le phénomène ne gêne pas forcément le travail des scientifiques qui ont besoin de simuler l’activité cérébrale pour en comprendre les mécanismes. En effet, après avoir collecté un grand nombre de données associées à une même expérience, les chercheurs « simplifient » en quelque sorte les signaux : ils ont coutume de moyenner leurs données pour en éliminer les anomalies dues aux erreurs de mesure et aux éléments parasites. De la sorte, ils éliminent en général la composante irrégulière de l’activité cérébrale mentionnée plus haut.

« Or nous avons montré que ces signaux complexes et erratiques ne sont pas justes du bruit de fond. Ils véhiculent une information utile à travers le cerveau. Une information qui, de mon point de vue de spécialiste en modélisation, est intéressante à conserver pour mieux comprendre le fonctionnement cérébral », commente Matteo Di Volo. Le chercheur fait référence à des travaux qu’il a publiés en 2023 dans la revue Nature Communications. Menés en collaboration avec une équipe de chercheurs franco-italienne, ils visaient à modéliser les ondes gamma traversant le cerveau d’une souris. De fréquence élevée, entre 35 et 80 hertz, ces ondes cérébrales apparaissent lorsqu’un individu est engagé dans une activité mentale intense.

Nous avons montré que les signaux de basse intensité issus de l’hippocampe prédisaient la position de la souris.

Pour ce faire, la souris a été équipé d’électrodes qui ont enregistré son activité cérébrale alors qu’elle se déplaçait librement à travers un labyrinthe à la recherche d’une récompense : un petit morceau de sucre. Des électrodes collectaient les signaux électriques de son hippocampe, une région du cerveau qui permet à l’animal de se repérer dans l’espace, lors de ses déplacements comme pendant ses pauses. En analysant les oscillations gamma obtenues, les scientifiques ont alors repéré une catégorie particulière de signaux. Très brefs et de faible intensité, ces derniers étaient aussi très irréguliers. « Grâce à des outils de machine learning, nous avons analysés ces signaux et montré qu’ils permettent à eux seuls de prédire la position de la souris en mouvement », complète Matteo Di Volo. Cette petite part de l’activité cérébrale de l’hippocampe, complexe, encode donc elle aussi la navigation de la souris dans l’espace.

Mais ce n’est pas tout. Poursuivant l’exploitation de leurs données et en s’inspirant des propriétés biologiques des réseaux de neurones de l’hippocampe, les chercheurs ont créé un modèle de RNA permettant de simuler lesdits signaux. Leur objectif : identifier les processus physiologiques susceptibles de les générer. Les processus ou plutôt les responsables…

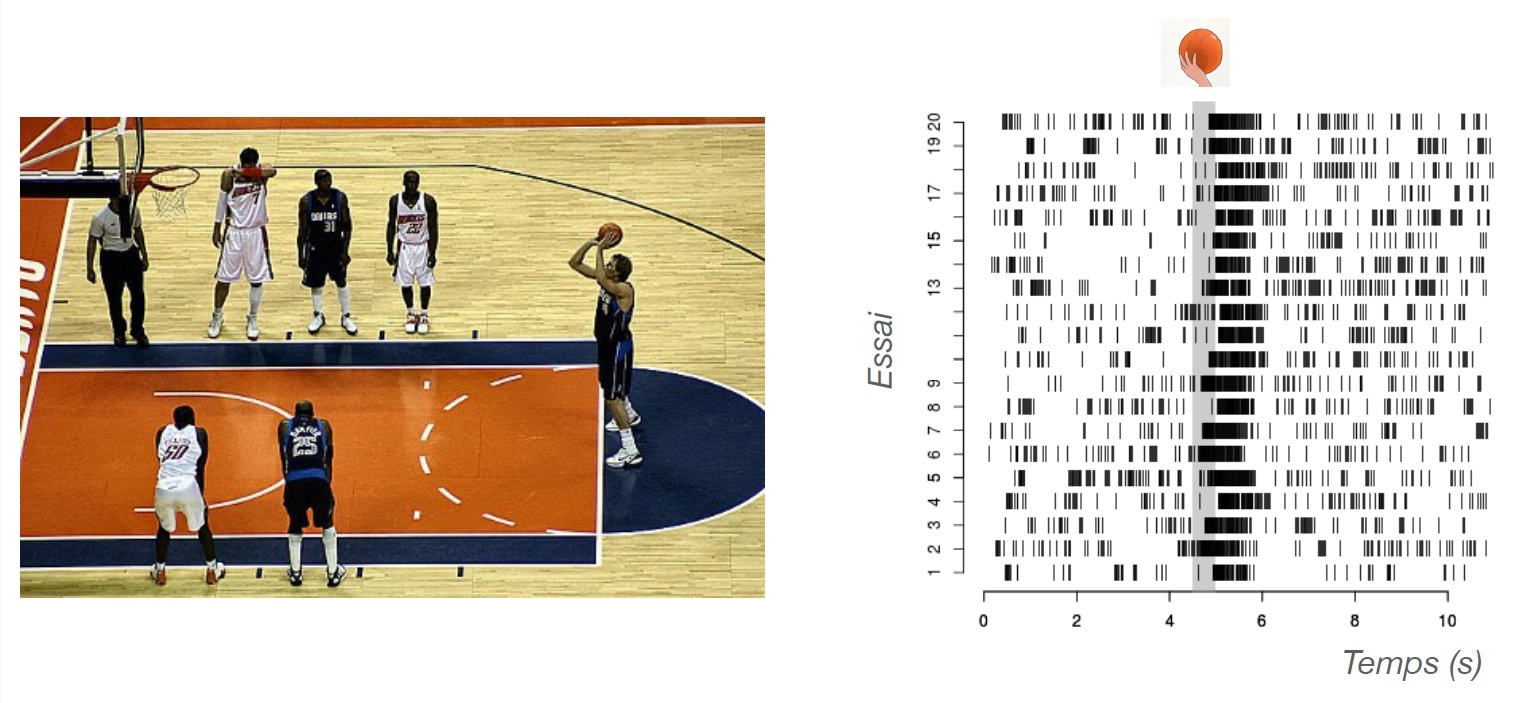

A gauche : cas où le nombre de signaux excitateurs est plus important que les signaux inhibiteurs. Le neurone est très actif et son activité très régulière. Au centre : la balance inhibition/excitation est à l’avantage de l’inhibition. Le neurone ne peut envoyer de signal électrique. A droite : la balance inhibition/excitation est équilibrée. Le neurone alterne entre des phases d’activation et d’inactivation, donnant lieu à une activité irrégulière et extrêmement flexible. © M. Di Volo

Car pour le neuroscientifique, il est question de se placer à l’échelle des neurones pour chercher l’origine de ces signaux complexes. A la différence de la majorité des réseaux artificiels utilisés en IA, dans notre cerveau, il existe deux populations de cellules nerveuses aux effets antagonistes : les neurones excitateurs qui activent leurs voisins lorsqu’ils sont eux-mêmes activés, et des neurones inhibiteurs qui désactivent leurs voisins dans la même situation. Dans un cerveau sain, un équilibre fin émerge entre ces deux populations de neurones : leurs activations se compensent globalement (voir figure 4).

Pour Matteo Di Volo : « Nous montrons que cet équilibre est à l’origine de l’activité neurale irrégulière observée sur nos tracés, et à l’origine de la complexité des oscillations gamma. Cette propriété est nécessaire d’ailleurs pour que nous fassions preuve de flexibilité mentale, et donc d’adaptation. Pour qu’une IA soit flexible, il faudrait concevoir des réseaux de neurones artificiels dotés de la même propriété ». Possible ? « Une entreprise… de longue haleine », conclut avec sourire le chercheur.