Comment se fait-il que je ressente la texture du papier quand je dessine avec un crayon ? Quelles informations sensorielles le cerveau utilise-t-il pour décrypter la matière à travers un objet ? Quels sont les mécanismes neuronaux en jeu ? C’est à ces questions passionnantes que deux chercheurs lyonnais viennent de répondre dans un article publié dans la prestigieuse revue Nature.

Gravure de l’édition originale de la Dioptrique de Descartes.

Le questionnement n’est pas nouveau. Dans La Dioptrique, son traité sur l’optique (1637), le philosophe mathématicien et physicien français René Descartes écrivait déjà : «Ne méprisez pas le bâton, il est capable de nous renseigner aussi bien, et mieux, que la lumière pour peu qu’on en sache l’usage.» Et pour illustrer son propos, il se référait à l’usage qu’en font les personnes aveugles : «On pourrait quasi dire qu’ils voient des mains, ou que leur bâton est l’organe de quelque sixième sens.»

Point n’est besoin d’être aveugle pour réaliser ce mystérieux phénomène. Il suffit de prendre un crayon et d’écrire sur une feuille de papier pour en ressentir la texture (mat, glacé, cartonné…). Pourtant il n’y a aucun capteur dans un crayon. Il s’agit d’une simple mine de carbone entourée de bois. Alors, comment se fait-il que la perception du toucher soit comme projetée dans le crayon ? Cette question est au cœur des recherches de Luke Miller, post-doctorant dans l’équipe ImpAct au sein du Centre de recherche en neurosciences de Lyon (CRNL). Et elle en a suscité d’autres. Quelles informations sensorielles le cerveau utilise-t-il pour projeter ainsi le toucher dans un objet tenu à la main ? Quels sont les mécanismes neuronaux sous-jacents à ce phénomène ? C’est pour y répondre qu’il a rejoint l’équipe d’Alessandro Farnè, directeur de recherche au CRNL, lui-même passionné par le rapport de l’être humain aux outils. «Toute manipulation d’outil possède une composante motrice et une composante sensorielle, qui nous renseigne en retour sur ce qu’on touche, explique-t-il. Jusqu’ici, on s’était surtout intéressé à la composante motrice. Les travaux de Luke ont ouvert des pistes prometteuses pour ce qui est de la composante sensorielle.»

Le cerveau intègre momentanément l’outil dans sa représentation du corps

En effet, dans de précédentes recherches [1], Luke Miller a montré comment l’utilisation d’un outil «recalibrait» la manière dont nous percevons notre corps et agissons : «J’ai constaté que l’utilisation d’un objet long – en l’occurrence une pince à déchets d’une trentaine de centimètres – modifiait la perception tactile sur le bras de l’opérateur ainsi que la cinématique de son mouvement, comme si le cerveau avait momentanément intégré l’outil dans sa représentation du corps.»

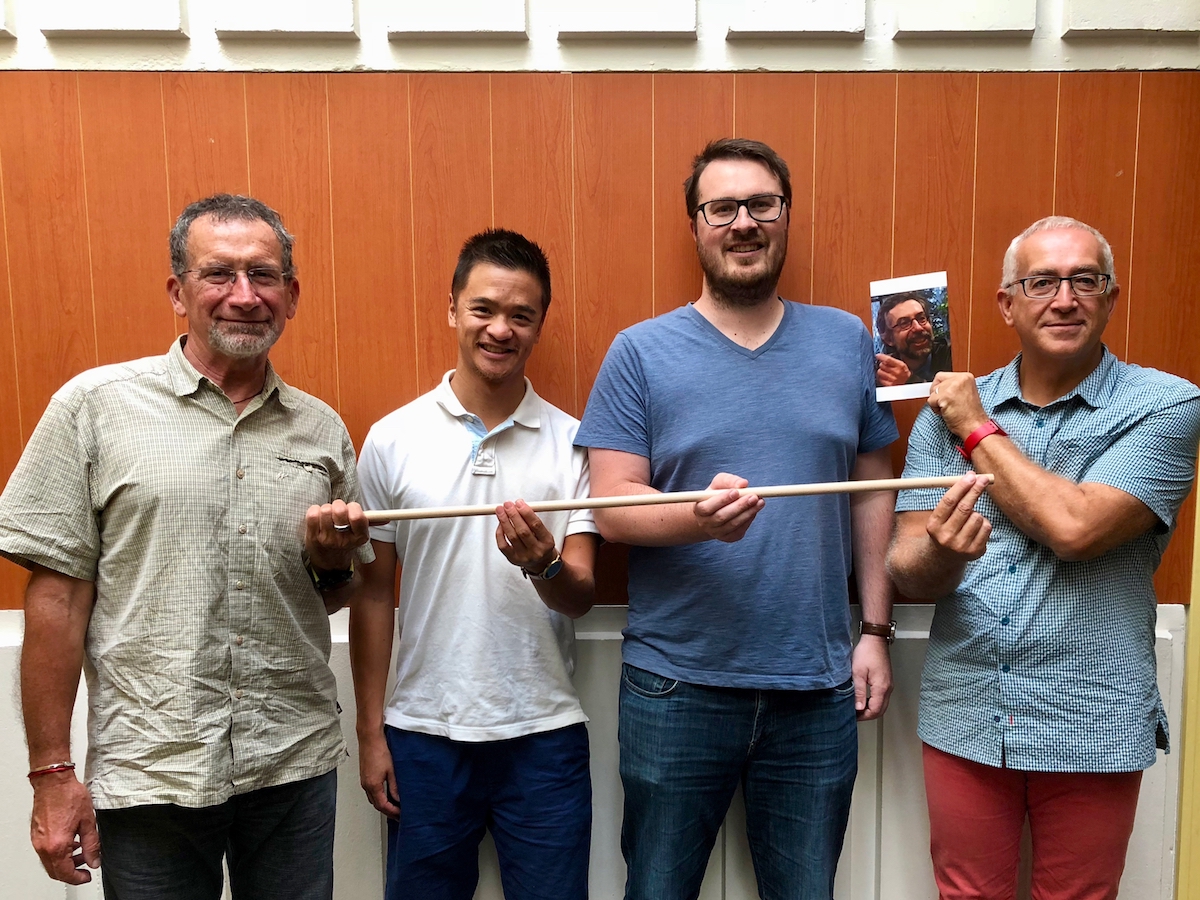

De gauche à droite : Romeo Salemme, Eric Koun, Luke Miller, Vincent Hayward (portrait) et Alessandro Farnè. Les chercheurs ont montré qu’une simple baguette pouvait devenir une extension de notre système sensoriel.

Ces résultats ont immédiatement suscité l’intérêt d’Alessandro Farnè, qui travaille depuis des années sur ces thématiques par des approches des neurosciences naturalistes [2], et le début d’une collaboration qui vient de déboucher sur la publication d’un article dans la prestigieuse revue Nature. Qu’ont découvert les deux chercheurs ? Que la perception n’était pas projetée de la main vers l’extrémité de l’objet, comme on le pensait jusqu’ici, mais que l’outil tout entier devenait une extension sensorielle du corps.

Comment sont-ils parvenus à ce résultat ? Luke Miller a mis au point une expérience très simple. Pour m’en faire comprendre le principe, il m’a proposé d’en réitérer une version simplifiée dans son bureau. Après m’avoir demandé de fermer les yeux, il m’a proposé de saisir une baguette puis l’a frappée en différents endroits en me demandant à chaque fois de situer la position de l’impact par rapport au précédent. J’ai pu ainsi me rendre compte que, bien qu’aveugle, j’avais une perception assez fine de l’endroit où la baguette avait été percutée.

Le sujet perçoit l’impact sur la baguette presque aussi finement que si l’on frappait son bras

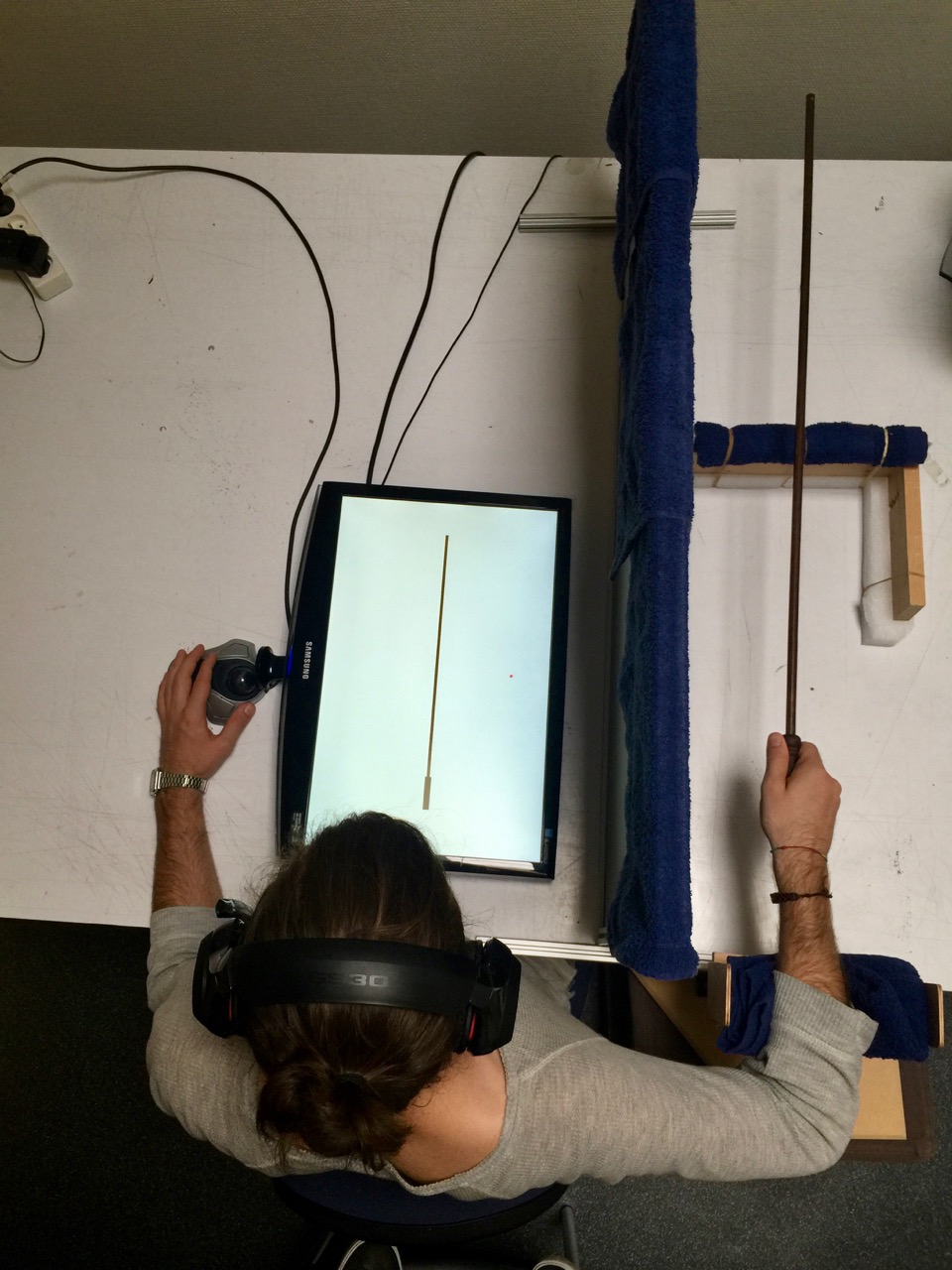

Dispositif expérimental permettant d’évaluer la perception du point d’impact sur la baguette.

Évidemment, le protocole expérimental mis au point par Luke Miller est plus sophistiqué. Dans son dispositif, le sujet tient une baguette qui repose sur un support ; il ne peut voir ni sa main ni la baguette mais seulement un écran sur lequel s’affiche une représentation de la baguette. Quand l’expérimentateur frappe la baguette, le sujet positionne le point d’impact sur l’écran en faisant varier un curseur avec sa main opposée (photo ci-contre). Deux modalités de l’expérience sont testées : dans le premier cas, le sujet soulève la canne et percute le support (mode actif) ; dans le second, l’expérimentateur agit sur le support pour percuter la canne (mode passif). Pour s’assurer de la robustesse des résultats, l’expérience est répliquée quatre fois et des mesures différentes sont pratiquées à chaque itération.

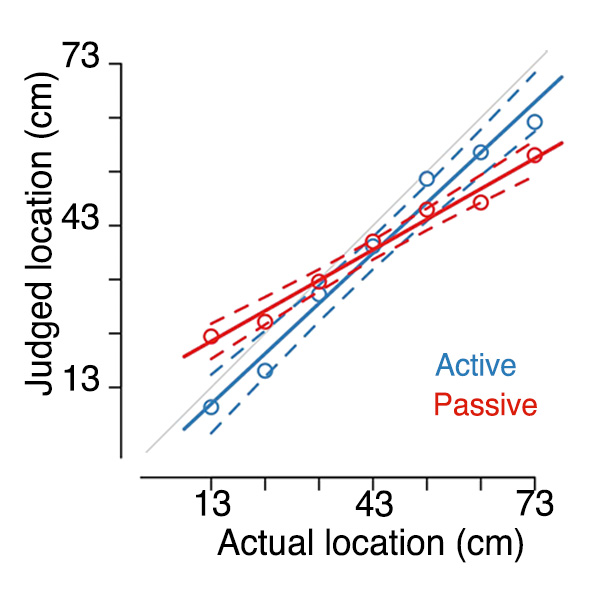

Que constate-t-il ? La perception du point de contact sur la canne se rapproche de celle que le sujet aurait si on le touchait sur le bras (figure 1). Son hypothèse est donc confirmée : l’outil est bien incorporé à la représentation du corps. «On peut faire l’analogie avec les vibrisses du rat,suggère Luke Miller. En se déformant au contact de la matière, ces longs poils qui ornent son museau transmettent au rongeur des informations utiles pour explorer son environnement.»

Figure 1 : Que le toucher soit actif ou passif, les participants indiquent avec une grande précision le point d’impact sur la baguette. Les pointillés délimitent un intervalle de confiance de 95%. En gris, la correspondance parfaite.

Les neuroscientifiques ont utilisé la théorie des poutres pour valider leur hypothèse

Parvenus à cette conclusion, nos chercheurs passent à la question suivante : comment expliquer ce phénomène ? Pour y répondre, ils font appel à des spécialistes de la mécanique des structures : Vincent Hayward, chercheur à l’Institut des systèmes intelligents et de robotique et professeur à la Sorbonne, Eric Koun et Romeo Salemme, ingénieurs de recherche dans l’équipe Impact.

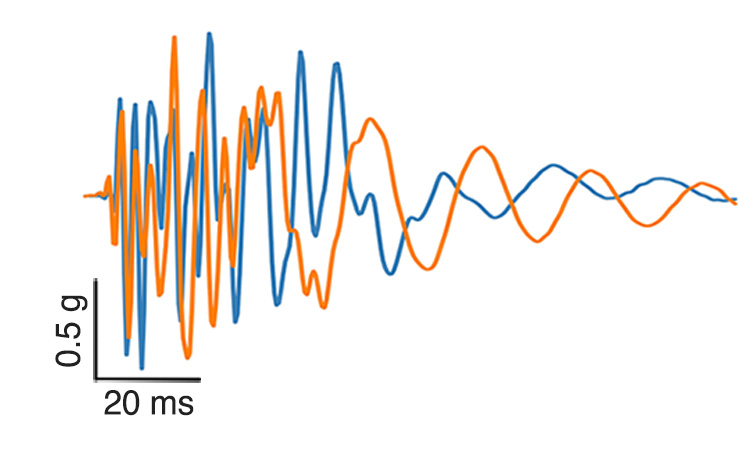

Ces experts enregistrent les vibrations transmises aux récepteurs de la main par la baguette lors des impacts. Ils observent que chaque impact transmet un motif vibratoire unique (figure 2). Utilisant une théorie de la physique des poutres (Euler-Bernoulli), ils montrent que l’amplitude de la vibration varie en fonction de la position du point d’impact conformément au modèle d’Euler-Bernoulli. «En termes neuroscientifiques, on peut dire que les vibrations constituent un encodage préneural du signal transmis aux mécanorécepteurs de la main», précise Alessandro Farnè.

Figure 2 : chaque impact sur la baguette génère un motif vibratoire spécifique.

Le toucher, un sens méconnu

Le toucher, un sens méconnu

Comme les autres sens, le toucher permet de traduire la réalité du monde en informations compréhensibles pour le cerveau. Mais il s’agit d’une modalité sensorielle complexe qui nous fournit toutes sortes d’informations (on parle de submodalités) : des récepteurs situés sur la peau et dans tout le corps, nous renseignent ainsi sur la pression, l’étirement ou les vibrations (mécanorécepteurs), le chaud et le froid (thermorécepteurs), la douleur (nocicepteurs), mais aussi sur la position de notre corps dans l’espace (proprioception). Malgré son intérêt, le toucher est un sens un peu négligé par rapport aux autres. « Certainement parce qu’il est moins facile à étudier »,estime Alessandro Farnè. Il est vrai qu’il n’est pas simple de reproduire en laboratoire des stimuli tactiles avec la finesse du réel,reconnait le chercheur.

Le questionnement des deux chercheurs ne s’est pas arrêté là. Ils ont voulu s’assurer ensuite que le signal transmis par la baguette à la main était bien celui qui était ensuite envoyé au cerveau. Pour cela, ils ont utilisé un modèle (TouchSim) qui permet de simuler l’encodage neuronal des mécanorécepteurs de la main quand ils enregistrent un signal d’impact plus ou moins éloigné. A leur grande satisfaction, ils ont constaté que le motif vibratoire de l’encodage neuronal se superposait parfaitement avec celui de l’encodage préneural précédemment réalisé. «La preuve était faite que le signal transmis par la baguette était bien utilisable par le cerveau», résume Luke Miller.

A présent qu’ils ont compris comment un objet peut devenir une extension sensorielle de notre corps, nos deux chercheurs cherchent à savoir si leur découverte peut avoir des applications intéressantes. A ce jour, deux projets sont en cours : l’un vise à étudier ce phénomène chez les personnes non-voyantes ; le second concerne l’amélioration des prothèses pour améliorer l’expérience sensorielle des personnes amputées. D’autres idées sont en germe : dans le domaine de la réalité augmentée, par exemple, pour l’industrie, l’événementiel ou le divertissement. Bref, ce superpouvoir dont nous sommes tous dotés n’a pas fini de nous étonner.

Avec l’aimable autorisation des auteurs et de la revue Nature pour la publication des graphiques et de la photo du dispositif expérimental.

Lire l’article original publié dans la revue Nature.

> Sensing with tools extends somatosensory processing beyond the body

Tool morphology constrains the effects of tool use on body representations. Miller LE, Longo MR, Saygin AP. J Exp Psychol Hum Percept Perform. 2014 Dec;40(6):2143-53. doi: 10.1037/a0037777. Epub 2014 Aug 25. PMID: 25151100 [PubMed – indexed for MEDLINE]

Tool-use: An open window into body representation and its plasticity. Martel M, Cardinali L, Roy AC, Farnè A. Cogn Neuropsychol. 2016 Feb-Mar;33(1-2):82-101. doi: 10.1080/02643294.2016.1167678. Epub 2016 Jun 17. PMID: 27315277